扫码一下

查看教程更方便

为了从网页中提取数据,Scrapy 使用了一种称为基于 XPath 和 CSS 表达式的选择器的技术。 以下是 XPath 表达式的一些示例

<head> 元素内的 <title> 元素。<title> 元素中的文本。<td> 中选择所有元素。选择器有四种基本方法如下表所示

| 序号 | 方法 | 描述 |

|---|---|---|

| 1 | extract() | 它返回一个 unicode 字符串和所选数据。 |

| 2 | re() | 它返回一个 unicode 字符串列表,当正则表达式作为参数给出时提取。 |

| 3 | xpath() | 它返回一个选择器列表,该列表表示由作为参数给出的 xpath 表达式选择的节点。 |

| 4 | css() | 它返回一个选择器列表,代表由作为参数给出的 CSS 表达式选择的节点。 |

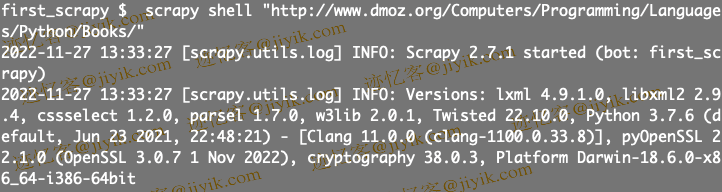

要使用内置的 Scrapy shell 演示选择器,我们需要在系统中安装 IPython。 这里重要的是,在运行 Scrapy 时,URL 应该包含在引号中; 否则带有 & 字符的 URL 将不起作用。 我们可以在项目的顶级目录中使用以下命令启动 shell

$ scrapy shell "http://www.dmoz.org/Computers/Programming/Languages/Python/Books/"

Shell 如下所示

[ ... Scrapy log here ... ]

2022-01-23 17:11:42-0400 [scrapy] DEBUG: Crawled (200)

<GET http://www.dmoz.org/Computers/Programming/Languages/Python/Books/>(referer: None)

[s] Available Scrapy objects:

[s] crawler <scrapy.crawler.Crawler object at 0x3636b50>

[s] item {}

[s] request <GET http://www.dmoz.org/Computers/Programming/Languages/Python/Books/>

[s] response <200 http://www.dmoz.org/Computers/Programming/Languages/Python/Books/>

[s] settings <scrapy.settings.Settings object at 0x3fadc50>

[s] spider <Spider 'default' at 0x3cebf50>

[s] Useful shortcuts:

[s] shelp() Shell help (print this help)

[s] fetch(req_or_url) Fetch request (or URL) and update local objects

[s] view(response) View response in a browser

In [1]:

当 shell 加载时,我们可以分别使用 response.body 和 response.header 访问正文或标头。 同样,我们可以使用 response.selector.xpath() 或 response.selector.css() 对响应运行查询。

例如

In [1]: response.xpath('//title')

Out[1]: [<Selector xpath = '//title' data = u'<title>My Book - Scrapy'>]

In [2]: response.xpath('//title').extract()

Out[2]: [u'<title>My Book - Scrapy: Index: Chapters</title>']

In [3]: response.xpath('//title/text()')

Out[3]: [<Selector xpath = '//title/text()' data = u'My Book - Scrapy: Index:'>]

In [4]: response.xpath('//title/text()').extract()

Out[4]: [u'My Book - Scrapy: Index: Chapters']

In [5]: response.xpath('//title/text()').re('(\w+):')

Out[5]: [u'Scrapy', u'Index', u'Chapters']

要从普通的 HTML 站点中提取数据,我们必须检查站点的源代码以获取 XPath。 检查后,我们可以看到数据将位于 ul 标记中。 选择 li 标签内的元素。

以下代码行显示不同类型数据的提取 -

用于选择 li 标签内的数据

response.xpath('//ul/li')

用于选择描述

response.xpath('//ul/li/text()').extract()

用于选择站点标题

response.xpath('//ul/li/a/text()').extract()

用于选择站点链接

response.xpath('//ul/li/a/@href').extract()

以下代码演示了上述提取器的使用

import scrapy

class MyprojectSpider(scrapy.Spider):

name = "project"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

for sel in response.xpath('//ul/li'):

title = sel.xpath('a/text()').extract()

link = sel.xpath('a/@href').extract()

desc = sel.xpath('text()').extract()

print title, link, desc